선거 90일 전 전면 금지 규정 무색

후보 목소리 덧씌운 로고송도 등장

의심되는 이미지 ‘역검색’ 활용해야

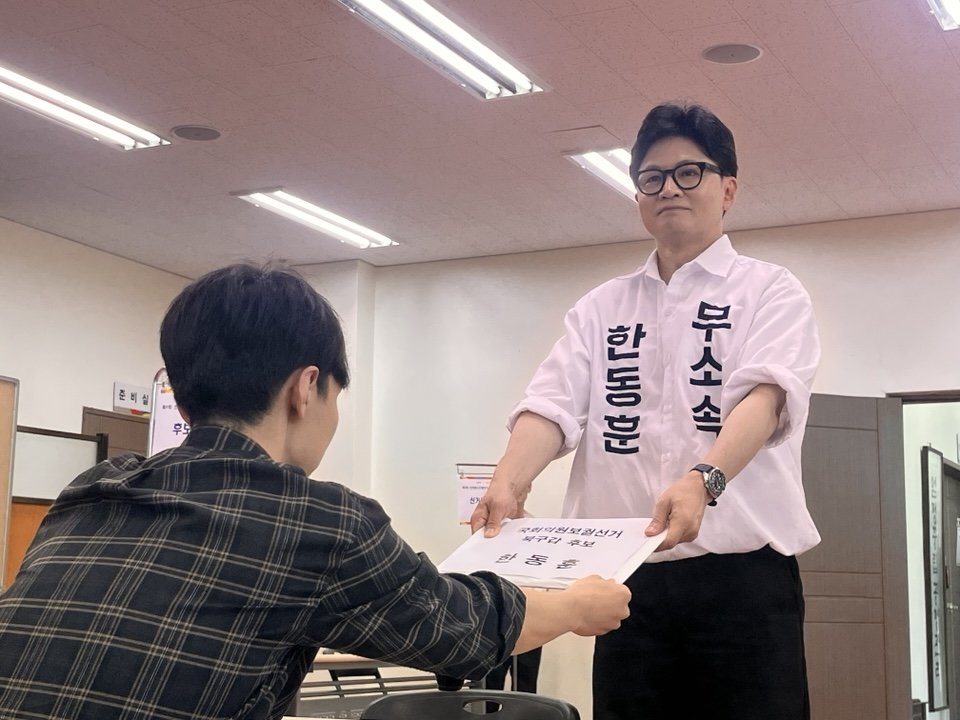

2023년 12월 공직선거법에 딥페이크 관련 규정이 신설되면서 선거일 90일 전부터 AI를 이용한 딥페이크 선거 영상이 전면 금지됐음에도 불구하고 이와 같은 선거 관련 딥페이크가 계속 제작, 유포되고 있다. 2월에는 허위 딥페이크 영상을 제작해 소셜네트워크서비스(SNS)에 게시한 지방선거 입후보 예정자 B 씨가 경찰에 고발되기도 했다. B 씨는 외국 유명 시사주간지가 지역 발전을 이끌 인물로 자신을 선정했다는 허위 내용의 영상을 제작한 후 AI 생성물 표시 없이 개인 SNS에 게시·유포한 혐의를 받고 있다.

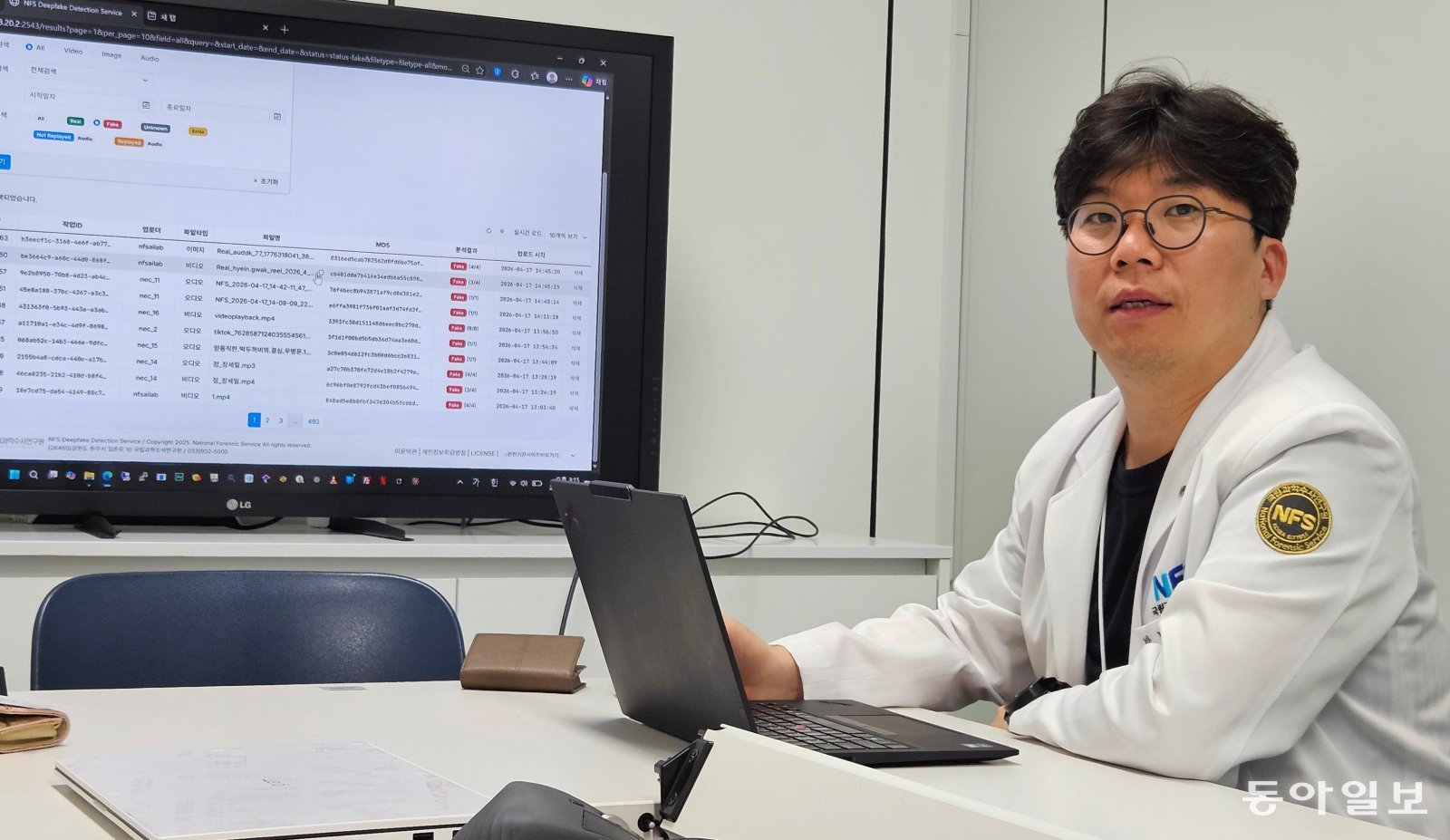

선거 국면에서 등장하는 딥페이크는 갈수록 정교해지는 추세다. 21일 박남인 국과수 디지털과 공업연구관은 “단순히 사진이나 영상을 조작하는 수준을 넘어 실사 사진으로 생성한 영상에 AI 음성을 입히거나 실제 음악 위에 합성 목소리를 덧씌운 선거송 형태의 콘텐츠까지 등장하고 있다”며 “진짜와 가짜가 뒤섞인 이런 콘텐츠는 일반인이 눈과 귀만으로 진위를 가려내기 더욱 어려워 각별한 주의가 필요하다”고 말했다.

유통 방식도 문제를 키운다. 이메일을 통해 원본 파일 형태로 유포될 때는 AI 조작 여부를 비교적 가려내기 쉽다. 하지만 유튜브에 올라간 영상이 다운로드된 뒤 메신저를 통해 재유포되는 과정이 반복되면 메타데이터가 삭제되거나 왜곡될 수 있다. 원본 정보가 훼손되면 딥페이크 여부를 판별하기가 한층 까다로워진다.딥페이크가 실제 유권자 판단에 영향을 미칠 수 있는 만큼 정부와 수사기관도 엄정 대응 방침을 세우고 있다. 다만 처벌 중심의 사후 규제만으로는 빠른 기술 발전의 속도를 따라잡기 어렵다. 박 연구관은 “시민 스스로 허위 정보를 가려낼 수 있는 역량도 함께 길러야 한다”고 강조했다.

의심스러운 이미지는 구글 이미지 검색에 올려 해당 이미지의 원본이 따로 있는지 확인하는 것이 가장 일반적인 1차 검증 방법이다. 눈을 깜박이지 않거나 말하는 입 모양과 음성의 싱크가 미세하게 어긋나는지도 주의 깊게 봐야 할 대목이다. 영상의 경우 특정 프레임을 캡처해 이전에도 존재했던 장면인지 살펴보는 등 역검색을 생활화하는 습관도 허위 정보 확산을 방지하는 데 도움이 된다고 박 연구관은 덧붙였다.

원주=김현지 기자 nuk@donga.com

© dongA.com All rights reserved. 무단 전재, 재배포 및 AI학습 이용 금지

- 좋아요 0개

- 슬퍼요 0개

- 화나요 0개

3 weeks ago

14

3 weeks ago

14

English (US) ·

English (US) ·